La IA Generativa se desliza al valle de la desilusión

De las expectativas infladas a la dura realidad de la aplicación práctica.

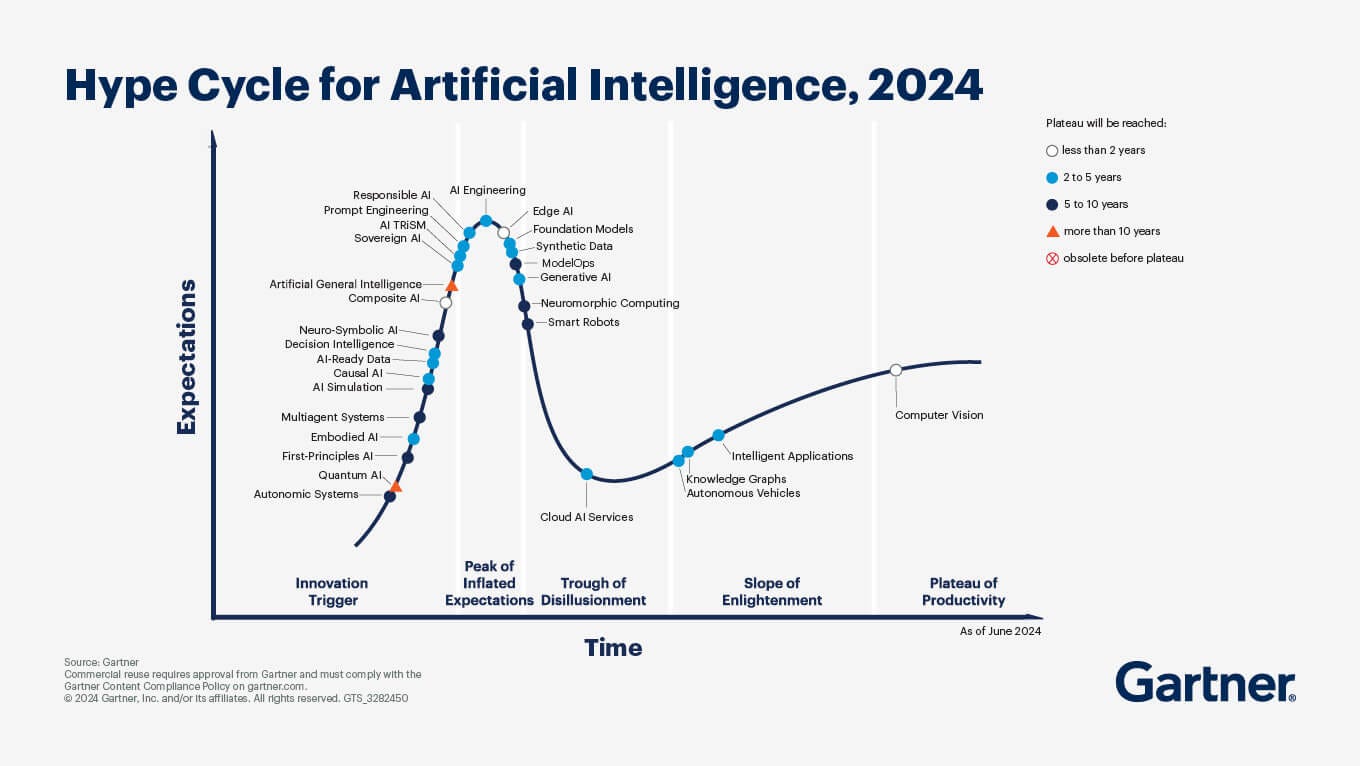

La inteligencia artificial generativa se ha convertido en el tema estrella de los medios digitales, conferencias y hasta conversaciones casuales. Desde titulares que prometían que la IA lo cambiaría todo, hasta demostraciones asombrosas en redes sociales, el hype creció sin límites. Sin embargo, como señala Gartner en su Hype Cycle for Artificial Intelligence 2024, hemos llegado a un punto donde la euforia comienza a enfrentarse con la realidad.

Comienza el descenso

El reconocido Hype Cycle for Artificial Intelligence1, desarrollado por Gartner, es una herramienta clave para entender la evolución de las tecnologías emergentes. Este ciclo describe cómo una tecnología pasa del entusiasmo inicial al desengaño, antes de alcanzar una adopción generalizada. En su edición 2024, el ciclo refleja cómo la IA generativa ha transitado del “Pico de Expectativas Infladas” al temido “Valle de la Desilusión”. En esta etapa es donde se hace evidentes las limitaciones de la tecnología, desafíos éticos, conflictos de derechos de autor, problemas de precisión y dificultades en la implementación práctica.

Los medios y el marketing contribuyeron a exagerar el potencial de la IA generativa, posicionándola como una solución casi mágica. Pasto para pseudo influencers hambrientos de algo novedoso con que llenar sus canales llenos de miniaturas llamativas y contenido sin verificar. Casos como el del “primer abogado robot”, que terminó con una multa de la FTC por publicidad engañosa2, son ejemplos claros de cómo las expectativas se desbordaron. Ahora, muchas empresas enfrentan una pregunta incómoda: ¿realmente vale la pena la inversión?

Vivir en el valle

Entrenar modelos de IA requiere grandes cantidades de datos, pero obtener datos reales puede ser caro, complicado o incluso ilegal en algunos casos debido a regulaciones de privacidad. Aquí es donde entran los datos sintéticos, información generada artificialmente para imitar datos reales. Gartner predice que, para 2026, el 75% de las empresas utilizarán datos sintéticos para entrenar sus modelos, comparado con menos del 5% en 20233. Esto es especialmente útil para sectores como la salud o las finanzas, donde los datos reales son sensibles y difíciles de compartir.

Antes, solo las grandes empresas podían acceder a la tecnología más avanzada. Ahora, gracias a plataformas como OpenAI, AWS y Google Cloud, las pequeñas y medianas empresas también pueden aprovechar la IA generativa usando un acceso API a un costo razonable. Estas plataformas ofrecen herramientas accesibles, lo que permite a las startups desarrollar productos específicos utilizando infraestructura y modelos ya existentes. Sin embargo, esta democratización en el acceso también significa que habrá más competidores en el mercado, lo que podría generar una saturación de soluciones similares. Las empresas deben diferenciarse ofreciendo valor único, como facilidad de uso, personalización o integraciones con otras herramientas.

La tendencia hacia modelos de inteligencia artificial generativa diseñados específicamente para industrias o funciones empresariales es un cambio importante. Actualmente, la mayoría de los modelos de IA generativa son generalistas (por ejemplo ChatGPT o Claude), lo que significa que se entrenan para manejar una variedad de tareas sin un enfoque particular. Esto los hace flexibles, pero no siempre óptimos para aplicaciones específicas. Gartner predice que, para 2027, más del 50% de los modelos de IA generativa utilizados por las empresas serán específicos para industrias, un gran salto desde el 1% en 2023. Esto significa que las organizaciones tendrán que invertir en la adaptación de los modelos a sus propias necesidades, lo que también generará oportunidades para consultoras y startups que se especialicen en esta personalización.

La inteligencia artificial multimodal, que permite a los modelos procesar texto, imágenes y audio de manera simultánea, está ganando impulso. Un ejemplo es el uso de modelos multimodales en el diagnóstico médico. Estos modelos pueden combinar análisis de texto (historial médico del paciente), imágenes (radiografías o resonancias magnéticas) y audio (grabaciones de consultas) para ofrecer diagnósticos más completos y precisos. Sin embargo, esta tecnología también presenta desafíos técnicos significativos. La integración de múltiples tipos de datos requiere modelos más complejos y potentes, lo que puede aumentar los costos de desarrollo e implementación. Además, el uso de datos tan variados plantea preocupaciones adicionales sobre privacidad y seguridad.

La expansión de la IA generativa no está exenta de riesgos. Los modelos pueden perpetuar sesgos existentes, generar desinformación o ser utilizados de manera indebida, como en campañas de desinformación o fraudes financieros. La gobernanza y la ética son ahora prioridades obligatorias para las empresas que implementan esta tecnología. Por ejemplo, los sesgos en los modelos de contratación basados en IA podrían llevar a decisiones discriminatorias, lo que no solo daña la reputación de las empresas, sino que también las expone a problemas legales. La gobernanza ética debe incluir auditorías periódicas para identificar y mitigar sesgos, transparencia en el desarrollo y uso de los modelos y capacitación en ética tecnológica para los equipos responsables de la IA.

Cuidado con el hype

Es fundamental no dejarse llevar por informaciones sensacionalistas que exageran las capacidades de la IA generativa4. No todas las empresas requieren necesariamente la implementación de la inteligencia artificial generativa más avanzada. A menudo, debido al miedo a quedar rezagadas frente a la competencia (también conocido como Síndrome FOMO5), las organizaciones pueden tomar decisiones apresuradas sin una evaluación exhaustiva de la verdadera necesidad. Antes de destinar recursos significativos, es esencial preguntarse cuál es el propósito específico de la implementación: ¿se busca mejorar la eficiencia operativa, fomentar la creatividad o automatizar procesos? Si el objetivo está claramente definido, resulta lógico invertir en la capacitación del personal o en la asesoría de expertos en inteligencia artificial, especialmente antes de realizar cambios en procesos críticos.

Finalmente, es importante que cualquier implementación de inteligencia artificial generativa o predictiva cumpla con estándares éticos rigurosos y garantice la seguridad y bienestar tanto de tu marca como de tus clientes. Esto incluye asegurarse de que los modelos no perpetúen sesgos, de que los datos utilizados estén protegidos según las regulaciones de privacidad, y de que la tecnología sea utilizada de manera responsable. Un error en esta área no solo podría dañar la reputación de la empresa, sino también tener implicaciones legales significativas, afectando tanto la confianza de los clientes como la estabilidad operativa.